李飞飞团队50美元训练出DeepSeek R1?真相到底是什么?

2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

DeepSeek的爆火,并让很多对手紧张,最主要是因为他把价格打下来了。在和朋友交流这件事情的时候,就提到,会不会再过一段时间,又有一个新的产品出来,替代DeepSeek的火,掀起新一轮浪潮。

话还没说完,新的“搅局者”就出现了。

从昨天下午开始,一条"震惊"“李飞飞”“50美元”“Deep Seek R1"这些热点词汇交织在一起的新闻,引起了人们的广泛转发和关注。

某个团队50美元就训练出了媲美DeepSeek R1的推理模型,简直是掀了Open AI和英伟达的桌子,即便是蒸馏出来的模型,那这么低的成本,OpenAI花了几十、几百亿美元做出来的模型,被轻松复制,那OpenAI的估值不得打个骨折?

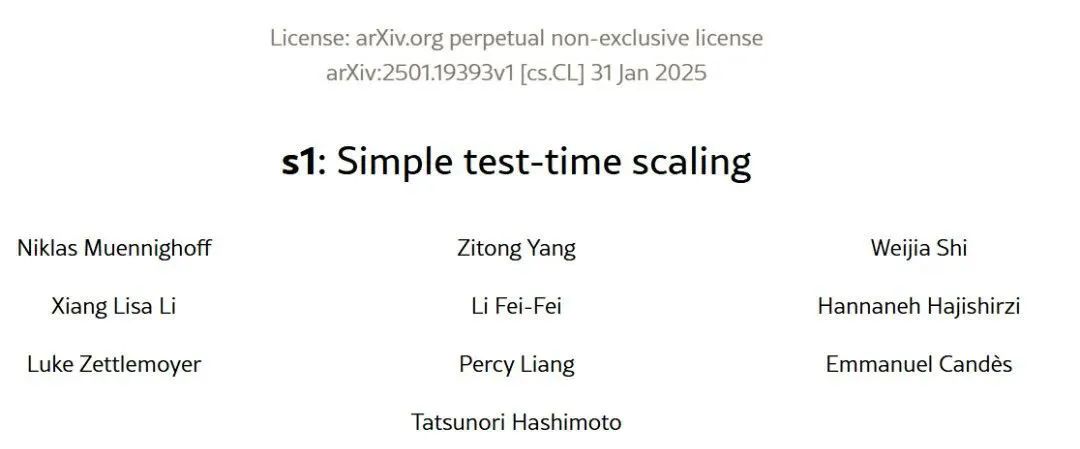

我就赶紧看了下论文:

https://arxiv.org/html/2501.19393v1

Github:

https://github.com/simplescaling/s1

结果发现并不是那么回事。

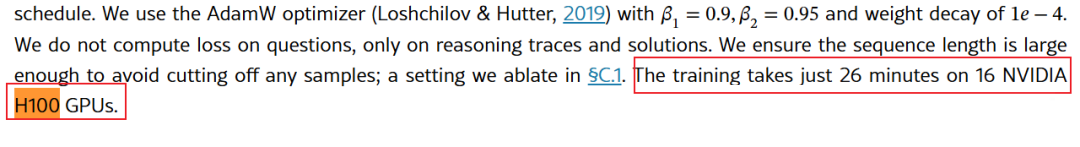

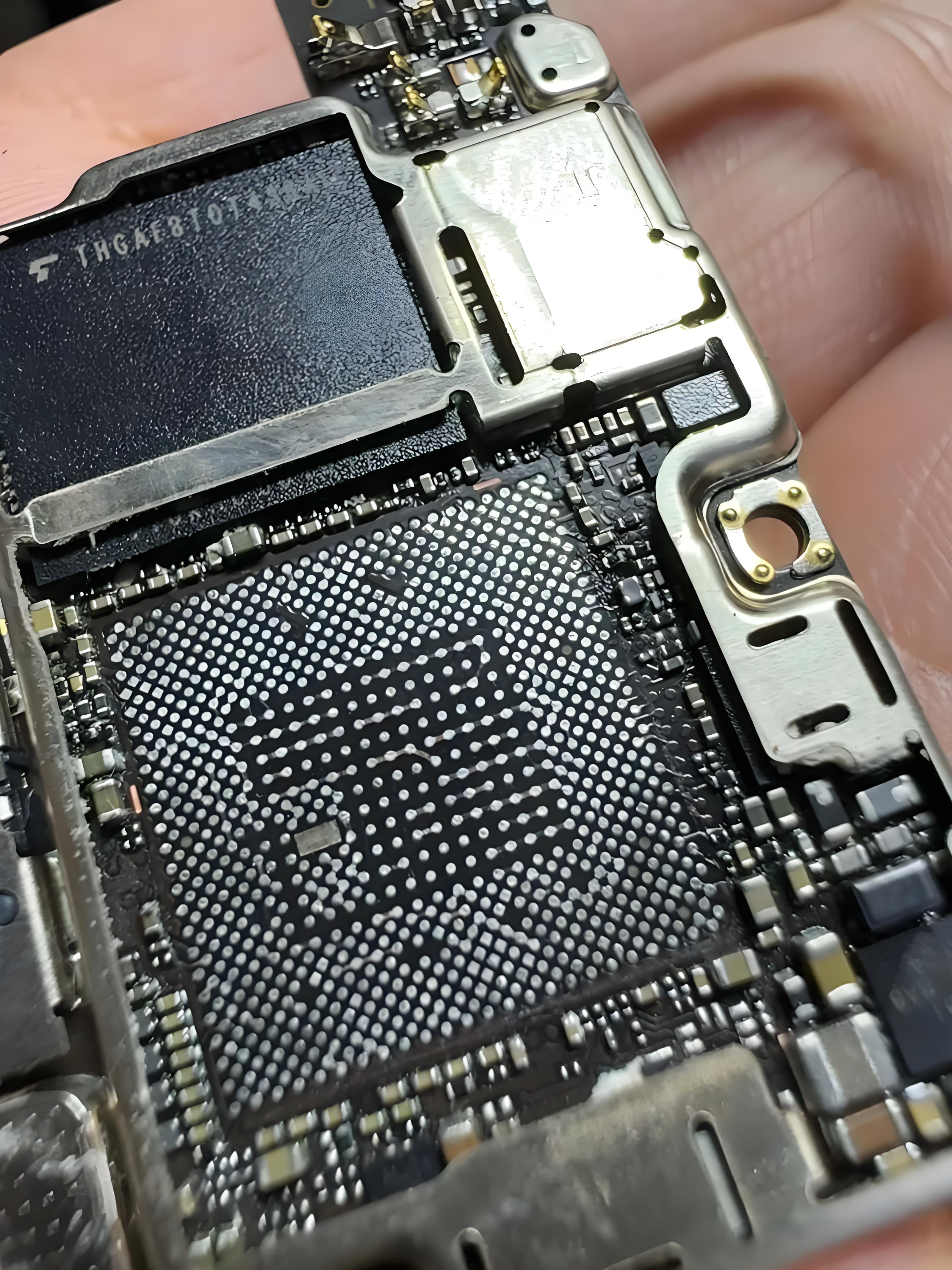

首先这个50美元咋来的?因为论文中提到用了16块H100 GPU,而且只花了26min,如果是租服务器的话,确实也就是几十美元。

但问题是,论文中并不是训练出了DeepSeek R1!

论文的核心内容是基于开源的Qwen2.5 - 32B模型,该模型是蒸馏出来的模型,32B只能算是中等参数模型,作为本次实验对比的R1和o1都是大几千亿参数的模型。用小数据集进行监督微调,而且微调后的参数数量跟之前基本保持一致,然后在特定任务上把性能优化了,而这些任务的性能表现可以媲美DeepSeek R1和OpenAI o1。

怎么经过中文博主翻译过来后,就成了50美元蒸馏出了DeepSeek R1?

在一个名为techcrunch的网站新闻上,也介绍了这个研究成果,内容显示,训练s1仅用了不到30分钟,动用了16个Nvidia H100 GPU,即可在部分AI基准测试中取得亮眼成绩。参与项目的斯坦福研究员Niklas Muennighoff告诉TechCrunch,他目前租用所需计算资源大概只需20美元左右。

比国内大家宣称的更低!

研究人员还采用了一项小巧门道,让s1在回答问题前能对自己的答案进行二次检查并延长“思考”时间:他们在s1的推理过程中加入了“wait”(等待)这一指令。论文指出,在推理过程中加入“wait”有助于模型给出更准确的答案。

针对上述论文,豆包进行了解读:

研究背景与目标:语言模型性能提升多依赖训练时计算资源扩展,测试时缩放是新范式,OpenAI 的 o1 模型展示了其潜力,但方法未公开。本文旨在探寻实现测试时缩放和强推理性能的最简方法。 s1K 数据集构建 初始数据收集:依据质量、难度和多样性原则,从 16 个来源收集 59,029 个问题,涵盖现有数据集整理和新的定量推理数据集创建,用 Google Gemini Flash Thinking API 生成推理轨迹和解决方案,并进行去重和去污染处理。 最终样本选择:经质量、难度和多样性三步筛选得到 1,000 个样本的 s1K 数据集。质量筛选去除 API 错误和低质量样本;难度筛选依据两个模型的性能和推理轨迹长度排除过易问题;多样性筛选按数学学科分类,从不同领域采样,且倾向选择推理轨迹长的样本。

测试时缩放方法 方法分类与提出:将测试时缩放方法分为顺序和并行两类,重点研究顺序缩放。提出预算强制(Budget forcing)方法,通过强制设定思考令牌的最大或最小数量,控制模型思考时间,引导模型检查答案、修正推理步骤。 基准对比:将预算强制与条件长度控制方法(令牌条件控制、步骤条件控制、类别条件控制)和拒绝采样进行对比。使用控制(Control)、缩放(Scaling)和性能(Performance)三个指标评估,结果表明预算强制在控制、缩放和最终性能上表现最佳。

实验结果 实验设置:用 s1K 对 Qwen2.5-32B-Instruct 进行监督微调得到 s1-32B 模型,在 AIME24、MATH500 和 GPQA Diamond 三个推理基准上评估,并与 OpenAI o1 系列、DeepSeek r1 系列等模型对比。 性能表现:s1-32B 在测试时缩放中,性能随测试时计算资源增加而提升,在 AIME24 上超过 o1-preview 达 27%,且是最具样本效率的开源数据推理模型,接近 Gemini 2.0 在 AIME24 上的性能,验证了蒸馏过程的有效性。

消融实验 数据相关:测试数据质量、多样性和难度组合的重要性。随机选择(仅质量)、仅多样性选择、仅难度选择(选最长推理轨迹样本)的数据集性能均不如 s1K,训练 59K 全量样本虽性能强但资源消耗大,证明 s1K 构建方法的有效性。 测试时缩放方法:预算强制在 AIME24 测试中控制完美、缩放良好、得分最高,“Wait” 作为扩展性能的字符串效果最佳。令牌条件控制在无预算强制时失败,步骤条件控制下模型可绕过计算约束,类别条件控制虽能提升性能但综合表现不如预算强制,拒绝采样呈现反向缩放趋势。

在科研界,有一句话,叫“站在巨人的肩膀上”,今天的很多创新成果,都是在前人努力的基础上,而这个研究成果,也是如此,但是,在对外宣称的时候,却把“前人”选择性忽视了,显然是不合理的。

单纯从成本的角度来说,考虑的只是按照分时租用的方式去考虑成本,这显然不是常规的成本计算方法。

为了抓眼球,选择性的放弃或忽视某些东西,有些是无知,而有些是纯粹的坏。

请先 登录后发表评论 ~