刚开源的DeepEP,会导致智能客服体验大跃进

2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

2026西湖龙井茶官网DTC发售:茶农直供,政府溯源防伪到农户家

DeepEP 是由 DeepSeek 开源的一款专为混合专家(MoE)模型训练和推理设计的 EP(专家并行)通信库。DeepEP 的开源为 MoE 模型的训练和推理提供了强大的通信支持,通过软硬件协同优化,显著提升了模型的运行效率。

以下是关于 DeepEP 的详细介绍:

核心功能

1. 高效通信机制

DeepEP 提供高吞吐量和低延迟的全到全(all-to-all)GPU 内核,支持节点内(intranode)和节点间(internode)通信,并兼容 NVLink 和 RDMA 技术。在 H800 GPU 和 400 Gb/s InfiniBand 网络环境下,节点内通信性能可达 153-158 GB/s,跨节点通信性能可达 43-47 GB/s。

2. 优化的内核设计

- 高吞吐量内核:适用于训练和推理的预填充阶段,显著提升数据处理速度。

- 低延迟内核:在推理解码阶段,采用纯 RDMA 技术,延迟低至 163 微秒,适合对延迟敏感的推理场景。

3. 低精度计算支持

DeepEP 原生支持 FP8 数据格式,显著降低内存需求并提升计算效率。

4. 通信与计算重叠

通过基于 Hook 的通信-计算重叠方法,DeepEP 实现了通信过程不占用 GPU 的流多处理器(SM)资源,进一步提升了推理效率。

5. 灵活的资源管理

DeepEP 支持灵活的 GPU 资源管理,允许用户控制 SM 的使用数量,适应不同的工作负载。

6. 针对 MoE 的优化

该库针对 DeepSeek-V3 论文中提出的组限制门控算法进行了优化,支持从 NVLink 到 RDMA 的非对称带宽转发。

适用场景

DeepEP 适用于需要大规模分布式训练和高效推理的 MoE 模型,尤其在 Hopper GPU 架构和 InfiniBand 网络环境下表现优异。

硬件与软件要求

- 硬件:需要配备 Hopper GPU 架构,未来可能会支持更多架构。

- 软件:需要 Python 3.8 及以上版本、CUDA 12.3 及以上版本、PyTorch 2.1 及以上版本。

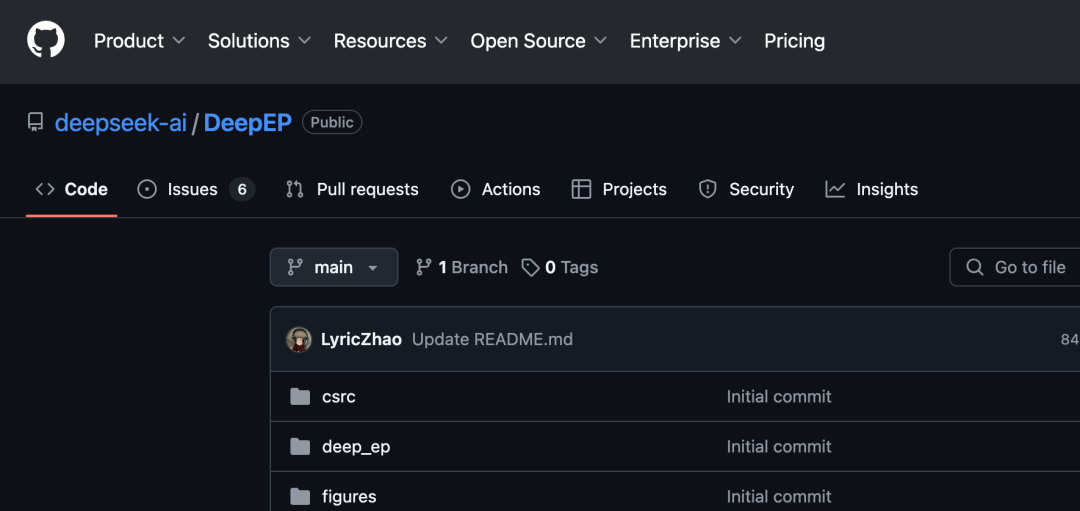

项目地址

DeepEP 的开源代码已发布在 GitHub,地址为:

https://github.com/deepseek-ai/DeepEP

问题一:DeepEP 在分布式训练中有哪些优势?

1. 高效优化的 All-to-All 通信机制

DeepEP 提供了高吞吐量和低延迟的全对全(all-to-all)通信内核,适用于 MoE 模型中的分发(dispatch)和合并(combine)操作。这种优化的通信机制显著提升了大规模分布式训练中的数据传输效率。

2. 支持 NVLink 和 RDMA 的节点内/跨节点通信

DeepEP 兼容 NVLink 和 RDMA 技术,能够实现节点内和节点间的高效通信。在 H800 GPU 和 400 Gb/s InfiniBand 网络环境下,节点内通信性能可达 153-158 GB/s,跨节点通信性能可达 43-47 GB/s。

3. 高吞吐量与低延迟内核

DeepEP 针对训练和推理的不同阶段提供了优化的内核。在训练的预填充阶段,高吞吐量内核可以显著提升数据处理速度;而在推理解码阶段,低延迟内核(延迟低至 163 微秒)能够满足对实时性要求较高的场景。

4. 原生支持低精度计算

DeepEP 原生支持 FP8 数据格式,这不仅降低了内存需求,还提升了计算效率,尤其适用于大规模 MoE 模型的训练和推理。

5. 通信与计算重叠

DeepEP 采用基于 Hook 的通信-计算重叠方法,通信过程不占用 GPU 的流多处理器(SM)资源,从而最大化计算效率。

6. 灵活的 GPU 资源管理

DeepEP 支持灵活的 GPU 资源管理,用户可以根据实际需求控制 SM 的使用数量,适应不同的工作负载。

7. 优化的网络配置

DeepEP 在 InfiniBand 网络上进行了全面测试,支持通过虚拟通道(VL)实现流量隔离,防止不同类型流量之间的干扰。

这些特性使得 DeepEP 在分布式训练中能够显著减少数据传输瓶颈,提升整体训练效率,尤其适用于需要大规模分布式训练的 MoE 模型。

问题二、DeepEP 支持哪些低精度计算?

1. FP8:DeepEP 完全支持 FP8 数据格式,这是一种比传统 FP16 或 FP32 精度更低的计算格式。使用 FP8 可以显著减少显存占用和计算资源,同时在保持合理精度的情况下,特别适用于超大规模 MoE 模型的训练和推理。

2. BF16:除了 FP8,DeepEP 还支持 BF16(Brain Floating Point 16)低精度格式。BF16 是一种用于深度学习的半精度浮点格式,能够进一步提升计算效率并降低内存需求。

这些低精度计算格式的引入,使得 DeepEP 在大规模 MoE 模型的训练和推理中能够显著提升性能,同时降低硬件资源消耗。

问题三:DeepEP 在哪些场景下表现最好?

DeepEP 在以下几种场景中表现尤为出色:

1. 大规模 MoE 模型训练

DeepEP 专为混合专家(MoE)模型设计,能够显著提升大规模分布式训练的效率。它通过优化的全对全(all-to-all)通信机制和高吞吐量内核,支持 NVLink 和 RDMA 网络,能够高效处理模型中的分发(dispatch)和合并(combine)操作。在 H800 GPU 和 400 Gb/s InfiniBand 网络环境下,节点内通信带宽可达 153-158 GB/s,跨节点通信带宽可达 43-47 GB/s。

此外,DeepEP 支持低精度计算(如 FP8 和 BF16),进一步降低了显存占用和计算开销,提升了训练效率。

2. 延迟敏感的推理任务

DeepEP 的低延迟内核特别适合对实时性要求较高的推理解码场景。它使用纯 RDMA 技术,将延迟降至最低,分发操作延迟低至 163 微秒,合并操作延迟低至 318 微秒。这种低延迟特性使得 DeepEP 在智能客服、金融风险评估等需要快速响应的应用中表现出色。

3. 高性能计算需求

DeepEP 支持 NVLink 和 RDMA 的非对称带宽转发,能够高效处理从节点内到跨节点的通信任务。它还引入了基于 Hook 的通信-计算重叠方法,不占用 GPU 的流多处理器(SM)资源,最大化计算效率。这种设计使得 DeepEP 在高性能计算场景中能够充分发挥硬件潜力。

4. 内容创作工具

DeepEP 的高效通信能力使其在 AI 绘画、AI 写作等内容创作工具中具有广泛的应用潜力。例如,在使用深度生成对抗网络(GAN)进行图像生成时,DeepEP 能够加速模型的推理过程,提升用户体验。

5. 智能客服和金融领域

在智能客服系统中,DeepEP 通过优化推理过程,能够快速响应用户问题,提升服务效率。在金融领域,DeepEP 可用于风险评估和自动化报告生成,通过分析企业财报和舆情数据,快速预测违约概率。

问题四:DeepEP 对智能客服系统有何优化作用?

DeepEP 在智能客服系统中的优化作用主要体现在以下几个方面:

1. 提升推理效率,降低响应时间

DeepEP 通过优化 MoE 模型的通信效率,显著降低了推理延迟。其低延迟内核能够将分发和合并操作的延迟分别降低到 163 微秒和 318 微秒。这种高效的推理能力使得智能客服系统能够快速响应用户咨询,提升用户体验。

2. 支持高并发处理

DeepEP 的高效通信机制和优化的内核设计使其能够支持大规模并发请求。在高并发场景下,智能客服系统可以快速处理大量用户的咨询,而不会出现响应延迟或服务中断。例如,中国联通在引入类似技术后,智能客服系统的平均响应时间缩短了 30%。

3. 增强模型性能,提升服务质量

DeepEP 支持低精度计算(如 FP8),在保持模型精度的同时,显著降低了计算资源的消耗。这使得智能客服系统能够在有限的硬件资源下支持更多的并发请求,同时提升回答的准确性和服务质量。

4. 个性化服务与情感分析

结合 DeepSeek 的强大语言理解能力,智能客服系统能够根据用户的历史交互数据和偏好提供个性化服务。此外,DeepSeek 的情感分析技术可以识别用户的情绪状态,并根据情绪调整回复策略,从而提升用户满意度。

5. 优化系统架构,降低人工成本

通过高效的模型推理和通信机制,智能客服系统能够实现更高的自动化处理能力。某知名电商企业在引入类似技术后,客服响应时间缩短了 50%,人工成本降低了 30%。这种优化不仅提升了服务效率,还为企业节省了大量资源。

6. 支持多模态交互

DeepSeek 的多模态融合能力使得智能客服系统能够支持多种交互方式,如文本、语音等,进一步提升了用户体验。

DeepEP 通过优化 MoE 模型的通信效率和推理性能,显著提升了智能客服系统的响应速度、并发处理能力和服务质量。它不仅降低了硬件资源消耗和人工成本,还通过个性化服务和情感分析增强了用户满意度。

(完)

入群联系|加微信89931668

免费DeepSeek教程与学习资料

请先 登录后发表评论 ~